特斯拉Autopilot系统被黑

导语:腾讯科恩实验室以特斯拉Model S(软件版本2018.6.1)为对象,针对其搭载的Autopilot系统进行安全研究,发现了自动驾驶系统的雨刷、车道的视觉识别缺陷和遥控器操控车辆行驶过程存在的问题。

研究简介

随着人工智能技术的快速发展,高级辅助驾驶相关技术正在汽车领域逐步落地,高级辅助驾驶相关安全也吸引了大众的广泛关注。

腾讯科恩实验室以特斯拉Model S(软件版本2018.6.1)为对象,针对其搭载的Autopilot系统进行安全研究,发现了自动驾驶系统的雨刷、车道的视觉识别缺陷和遥控器操控车辆行驶过程存在的潜在安全风险。

雨刷的视觉识别攻击

特斯拉Autopilot系统借助图像识别技术,通过识别外部天气状况实现自动雨刷功能。科恩实验室通过研究发现,利用AI对抗样本生成技术生成特定图像并进行干扰时,该系统输出了“错误”的识别结果,导致车辆雨刷启动。

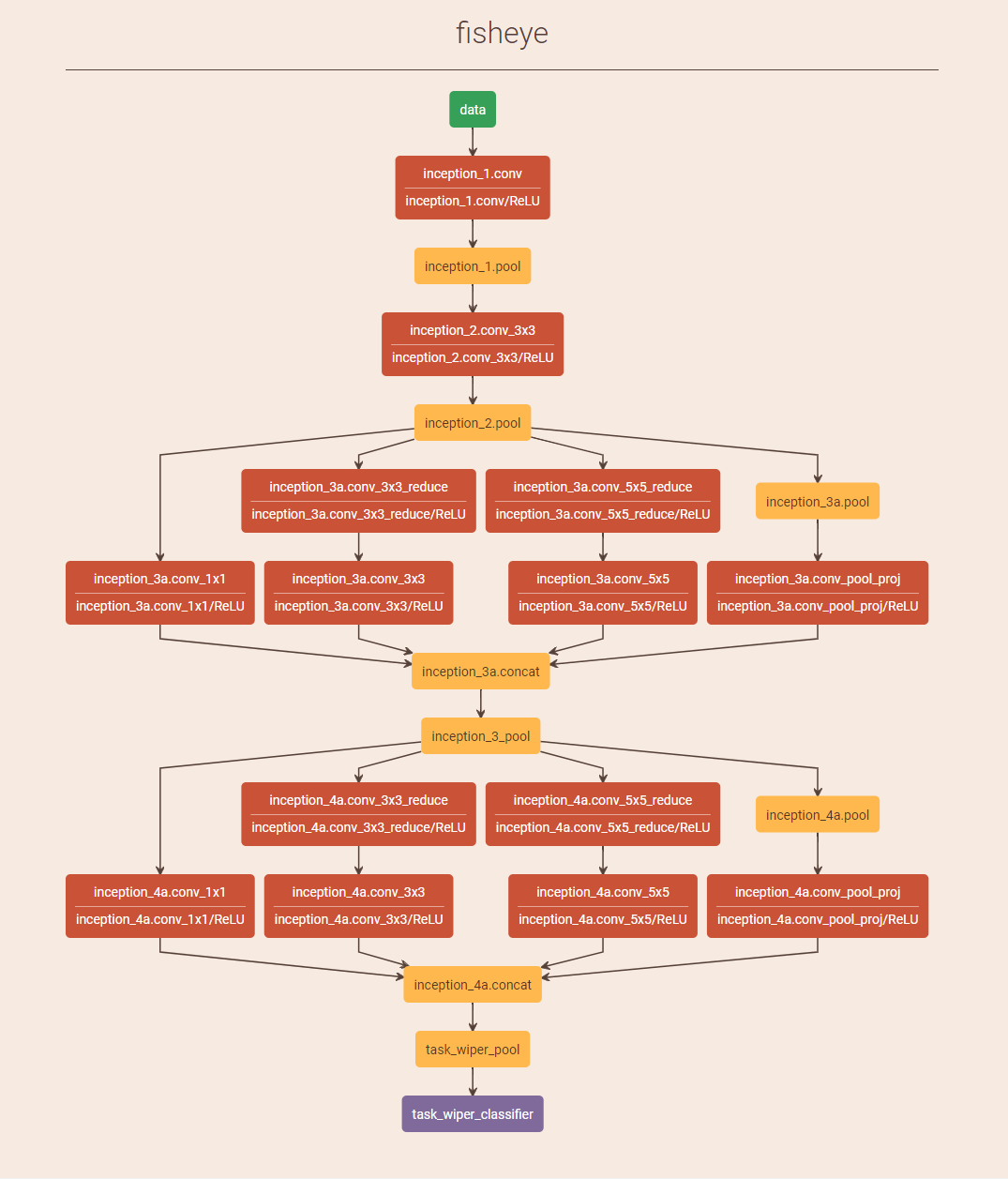

特斯拉自动雨刷功能的视觉神经网络

具体来看,120度fisheye摄像头会获取雨刷的图片,然后将数据发送给负责预处理的单独的神经网络。神经网络会给出一个表示雨刷上潮湿度的概率值,在0~1之间。

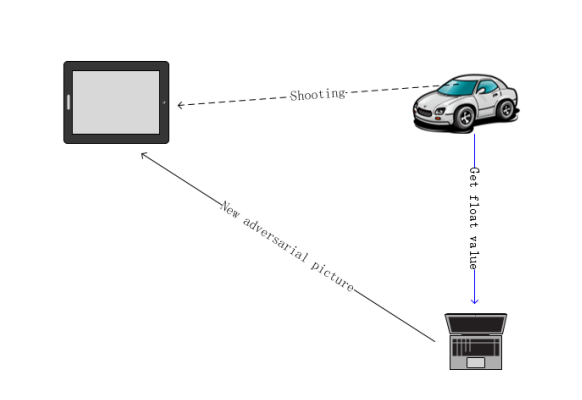

为了模拟雨滴的掉落,研究人员通过向摄像头展示一个伪造的图片就得到了想要的效果。虽然在现实情况下比较难以利用,但这并不是不可实现的。

车道的识别攻击

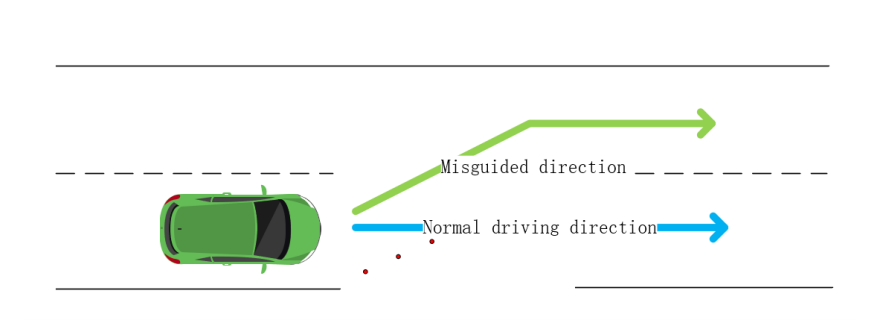

特斯拉Autopilot系统通过识别道路交通标线,实现对车道的识别和辅助控制。科恩实验室通过研究发现,在路面部署干扰信息后,可导致车辆经过时对车道线做出错误判断,致使车辆驶入反向车道。

Tesla的自动驾驶特征使用复杂的计算机网络来实时翻译环境数据以进行相应地操作。而环境数据的收集主要是通过摄像头、超声传感器和雷达。负责导航的的是检测和追踪(detect_and_track),它也会将数据提供给CUDA Kernel来正确判断和翻译路标。

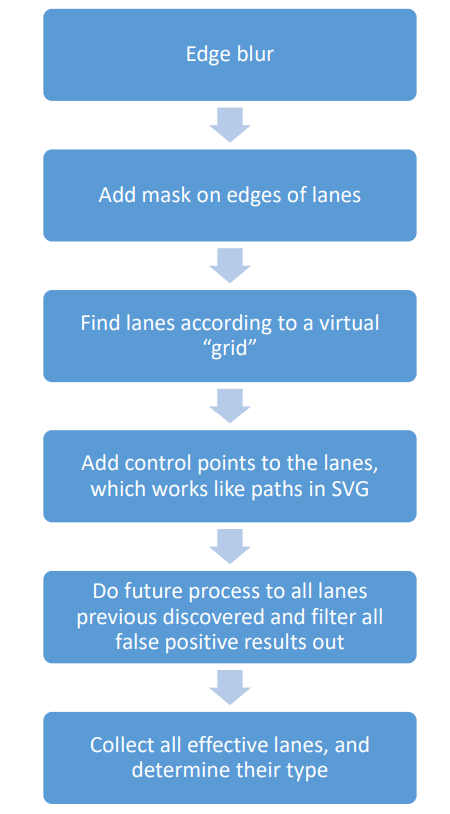

上图介绍了Tesla在当前车道中确定车道的过程,这也同样适用于车道偏离告警。

基于以上信息,自动驾驶汽车可以构建一个虚拟地图,为其他组件创建一个实时的高清地图。所以如果系统被欺骗检测到虚假的车道,汽车就会进入该车道并相信这是一个合法的车道标记。

研究人员称在测试区域进行小面积地涂改就可以欺骗Tesla Autopilot的视觉检测模块。通过这种攻击,汽车的视觉模块可以将这些伪造的车辆识别为真实的车道并允许Autosteer模块来进入。在实验过程中,车辆自动驾驶系统就被欺骗而偏离了正常行驶方向。

研究人员称因为Tesla汽车完全依赖计算机视觉解决方案来检测车道,因此这类攻击很容易实现,而且所需的材料也很容易获得。而且这类识别架构存在安全风险,在非封闭车道中进行自动驾驶时尤其需要注意车道识别的问题。

用遥控器操控车辆行驶

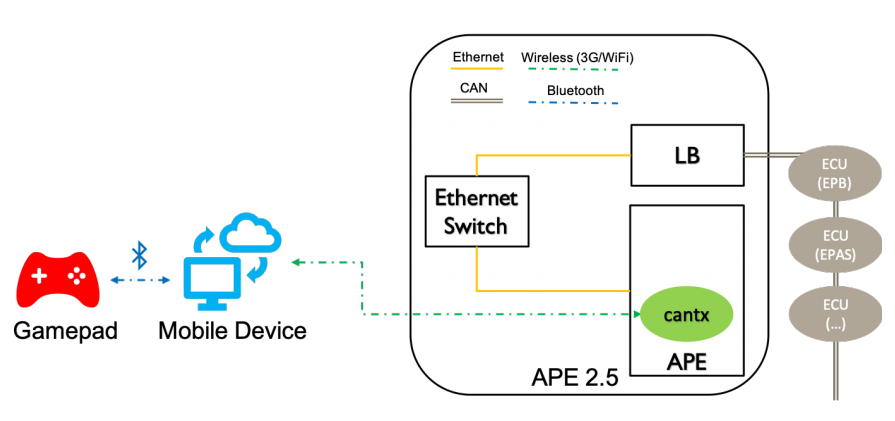

研究人员在2018年的Blackhat大会上就证明了可以利用其他组件的漏洞来获取Autopilot ECU (APE)的root访问权限。在本实验中,研究人员深入分析汽车网络并尝试获取驾驶系统的远程控制权限。

科恩实验室研究人员利用已知漏洞在特斯拉Model S(版本2018.6.1)获取Autopilot控制权之后,通过实验证明,即使Autopilot系统没有被车主主动开启,也可以利用Autopilot功能实现通过游戏手柄对车辆行驶方向进行操控。

有漏洞的固件版本为version 2018.6.1,在之后发布的2018.24版本中已经修复了该漏洞。

在获取了APE的root访问权限后,研究人员可以通过任意的CAN消息来影响汽车的Electric Power Assisted Steering (EPAS)单元并在不同的驾驶模式下控制它。驾驶制定是从手机设备上发送的,因此可以将控制信号翻译成驾驶系统的对应命令。

研究人员还使用通过蓝牙连接手机的游戏控制器来控制汽车。

研究人员发现在不同的驾驶模式下,该攻击会有不同的效果:

· 当汽车处于停止状态时,研究人员可以没有任何限制地控制驾驶系统;

· 当汽车从R转为D模式时,APE会认为汽车处于APC(Automatic Parking Control)模式,研究人员可以在8KM/h的速度控制驾驶系统;

· 当汽车处于ACC高速巡航模式时,研究人员可以没有任何限制地控制驾驶系统。

腾讯科恩实验室PoC视频:https://v.qq.com/x/page/l08556h0co6.html

更多技术细节参见白皮书Experimental Security Research of Tesla Autopilot https://keenlab.tencent.com/en/whitepapers/Experimental_Security_Research_of_Tesla_Autopilot.pdf

发表评论

提供云计算服务

提供云计算服务