“黑”掉神经网络:通过逆向模型文件来重构模型后门

导语:XCon安全焦点信息安全技术峰会(XFocus Information Security Conference),始于2002年,是国内首个信息安全行业技术峰会。

技术是强大的,它让梦境成为可能;技术是脆弱的,它让日常暗藏危机!

开车行驶在回家路上,拿出手机对准摄像头,用一句语音唤起“Siri”,让它完成播放音乐的简单指令,仅用时30秒,你便完成了一次与神经网络的交互体验。

伴随科技的快速发展,深度学习与AI技术在现实中拥有了愈发多样而灵活的应用场景,而深度学习在计算机视觉任务中获得的巨大成功,也令神经网络的安全问题逐渐暴露。

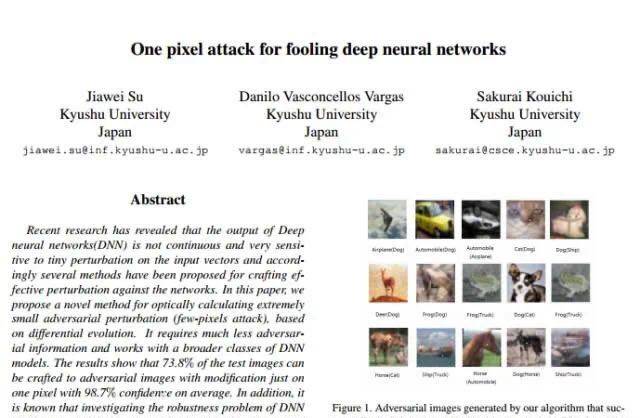

此前,一项来自日本的研究表明,搞垮强大的神经网络,仅需修改图片上的一个像素,导致的危害不仅仅是让神经网络认错图片,甚至还可以诱导它返回特定的结果。可见,深度学习模型具备天生的安全隐患,因此在传统的诸多案例中我们也看到,大量的研究者通过数据投毒的方式对模型植入后门,以实现攻击的核心目的。

随着技术研究的不断深入,安全专家也开始探索更为高级的攻击方式,例如:直接控制神经元,将AI模型改造为后门模型,进一步实现对神经网络的深层次攻击。在本次XCon2020的会议现场,这场安全与威胁间的正面对抗也即将展开。

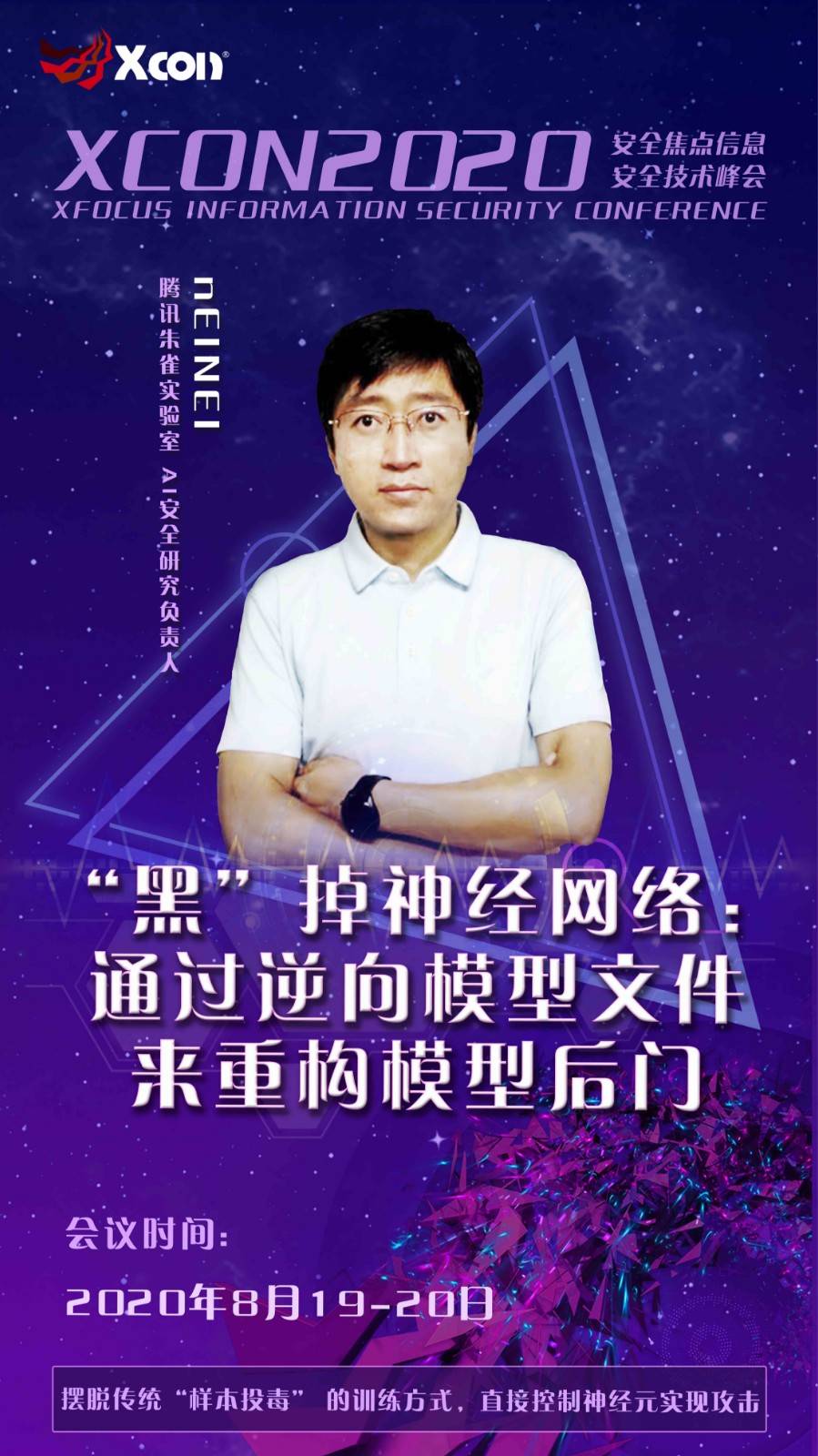

“黑”掉神经网络:通过逆向模型文件来重构模型后门

议题简介:

机器学习框架(Tensorflow,Torch,Caffe等)生成的模型文件会保留很多有用的信息。但由于深度神经网络的不可解释性,根据模型数据很难获得其准确含义,配合具体场景,在攻击者可以操纵模型文件或是接触模型文件的情况下完成多种攻击方式。

议题将摆脱传统的利用“样本投毒” 训练后门的方式,为大家展示通过直接控制神经元,将AI模型改造为后门模型,甚至在保留正常功能的前提下在模型文件中插入二进制攻击代码或是利用漏洞改造模型文件为攻击载体来执行恶意代码。

演讲者:

nEINEI,腾讯朱雀实验室,AI安全研究负责人。拥有10多年信息安全从业经验,致力于高级威胁对抗、漏洞利用技术、逆向工程、AI安全等研究。曾在CanSecWest,Blackhat,AVAR,XCon等国际安全会议上发表过议题演讲。

XCon2020 第19届 安全焦点信息安全技术峰会

会议时间:2020年8月19-20日

会议形式:线上直播

XCon安全焦点信息安全技术峰会(XFocus Information Security Conference),始于2002年,是国内首个信息安全行业技术峰会,现已发展成为国内“最知名、最权威、举办规模最大”的信息安全会议之一。

秉承“严谨求实、精进探索”的会议精神,XCon持续致力于信息安全行业生态体系的建设与发展。凭借前瞻性的技术分享、权威性的技术交流、开放性的人才培养成功吸引了两百余位国内外知名安全专家、技术人才、一线安全从业者,为国内信息安全行业优质生态的构建提供了“人才、技术、创新模式”等基础,也为信息安全从业者、爱好者构建起友好和谐的交流平台。

2020年,经历过疫情的沉淀与思考,XCon再度活力启程。更主流的形式、更精彩的议题、更深度的探索、更丰满的干货,期待你的加入!最新活动资讯,请关注XCon官方微信!

发表评论

提供云计算服务

提供云计算服务