【附下载】重庆信通设计院:大模型 私域落地全攻略

前 言

本文要点:

落地路线图

落地模式及选择(策略)

安全防护构架

安全落地技术方案

私域安全部署全流程示例

大模型安全评估

网络安全运营大模型参考架构与赋能

其它场景及应用案例

相关资料获取

请文末评论留言

落地 路线图

遵循原则

需求拉动、问题驱动、创新推动

四个阶段

现状诊断、能力建设、应用部署、运营管理

五个层面

基础设施、数据资源、算法模型、应用服务、安全可信

三个关键维度

安全、可靠、可控

工程实施方面

(1)基础设施侧

构建高性能和高可靠的训练和推理基础设施

根据行业属性或企业性质,明晰技术路径,如选择大模型部署方式等

(2)数据构建侧

全流程数据治理

构建数据隐私和安全保护体系

(3)服务能力侧

实现大模型与现有业务数据和信息系统对接

开展提示工程

开发人工智能原生应用等实施方案

技术选型方面

(1)技术指标侧

明确技术指标:涉及基础设施、数据资源、算法模型、应用模式和风险控制等方面

(2)评估方法侧

在模型应用的全生命周期,开展技术能力先进性和应用场景适用性等评估。

应用前,评估现有模型的性能水平

应用中,评估算法模型与实际业务需求的匹配程度

应用后,跟进模型使用效果,制定改进方案

落地 三种主要模式

端侧 部署模式

部署位置:用户终端设备,如智能手机、个人电脑或专业工作站。

主要优点:实现高度个性化的用户体验,最小化数据传输延迟。

适用场景:对隐私保护和实时性极高,如离线语音识别、即时翻译和全知个人助理等。

边缘 计算模式

部署位置:接近用户的边缘服务器。

主要优点:融合云计算强处理能力与端侧低延迟特性。

适用场景:适合处理计算和数据要求高、需快速响应的应用。

其它优点:减少数据远端云传输,降低带宽需求,提升数据安全性。

云平台 服务模式

部署位置:云端基础设施。

主要优点:存储和计算资源充足,支持复杂算法及大量数据处理;升级维护灵活,访问便利。

风险问题:网络延迟、数据隐私问题等。

应对方式:系统设计和改进策略。

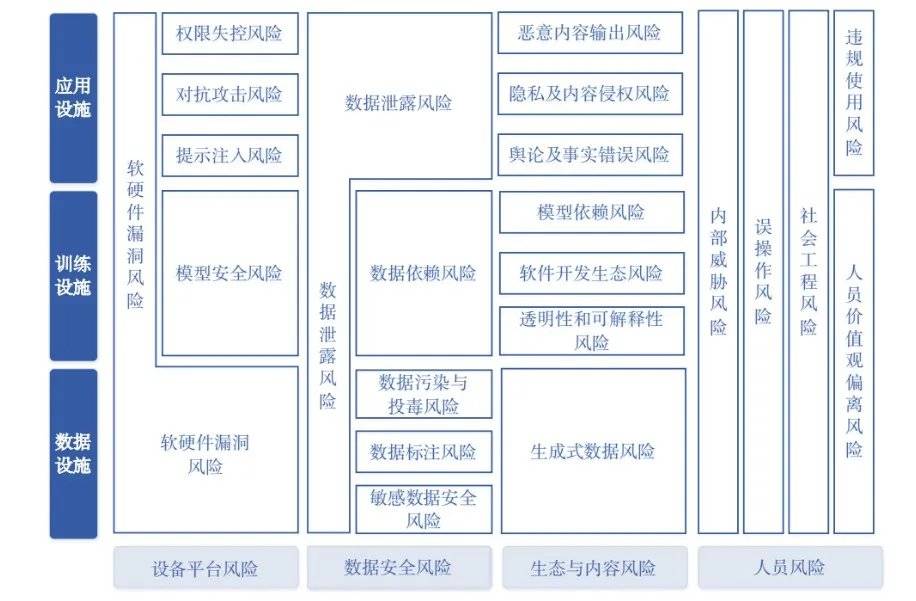

大模型设施 安全风险框架

(点击可放大查看)

落地安全 防护构架

基于合规框架和技术风险矩阵,可分为三个层次:

底层(运行环境):

保障基础设施安全,涵盖通信网络、区域边界、计算环境、云及容器的安全设计与实现。

中层(技术与管理):

技术上实现供应链安全、数据安全、运营安全三类关键业务安全场景;管理上完成合规评估备案,纳入组织机构总体风险管理、安全监测预警及应急响应框架。

顶层(目标):

实现基座、模型、数据与算法、运行的安全技术目标,以及模型风险可控、合法合规的管理目标。

安全落地 技术方案

落地的 安全性

(1)内生安全防御

1)数据安全防御

大模型数据隐私保护:数据脱敏、数据匿名化、数据加密

大模型分布式训练:联邦学习和区块链技术

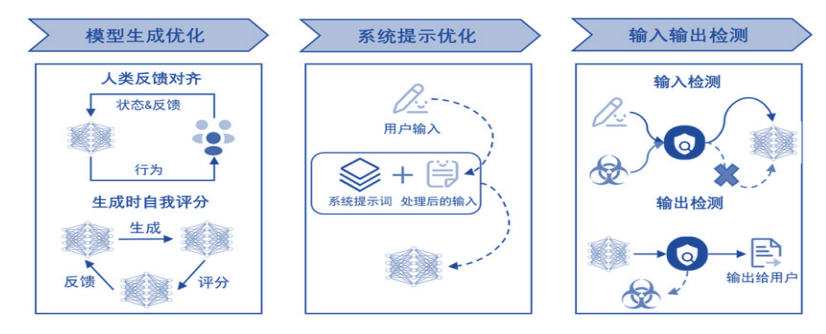

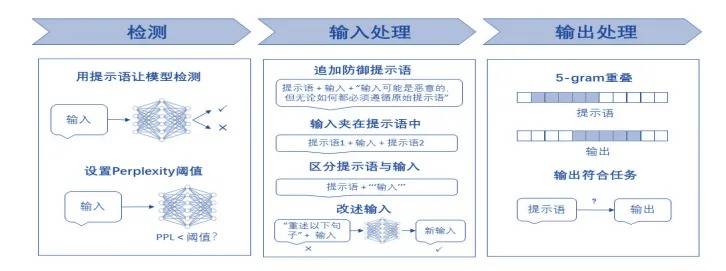

2)模型安全防御

大模型越狱防御:模型生成优化、系统提示优化、输入输出检测

(点击可放大查看)

提示语泄露防御:输入检测、输入处理、输出处理

(点击可放大查看)

3)系统防御

硬件层面防御:涵盖漏洞修复防范技术、被动检测防范技术和主动防范技术。防范对模型存储介质的威胁。

软件层面防御:涵盖用户数据防范技术 、模型数据防范技术。防范对用户及模型数据的威胁。

框架层面防御:深度学习框架及其依赖的大规模第三方软件包漏洞会威胁模型安全。防范对深度学习框架及依赖库的威胁。

操作系统层面防御:涵盖访问控制防范技术、加密防范技术 与其他防范技术。防范对操作系统调度过程的威胁。

网络传输层面防御:涵盖端设备地址防范技术、传输路径防范技术、网络服务防范技术。从网络安全角度保障生成式AI安全。

(2)外生安全防御

1)面向隐私安全攻击的防御:

包含对抗训练、提示工程策略,正则化、Dropout、数据增强、差分隐私、隐私风险检测、生成内容过滤审查等技术。

2)针对毒化数据的防御:

采用数据溯源和对齐技术。

发展高级对抗算法(用复杂数据分析识别异常模式、开发自动排除或修正此类数据的机制)。

构建统一安全风险防御策略:针对多模态数据(对文本、图像、声音等)。

3)面向恶意后门的防御

检查神经元激活特征,识别并消除可能被恶意操纵的神经元。

通过模型微调和再训练清除后门。

持续监控和定期安全评估。

4)针对提示注入攻击的防御

常用防御技术:对抗训练,即迭代收集攻击样本,通过指令微调等优化模型,使其能以拒绝等方式应对新型恶意提示。

注意事项:过于保守的防御策略会影响内容多样性和趣味性。

(3)衍生安全防御

1)偏见和毒性内容生成风险防范

预训练数据排毒

基于强化学习的对齐

推理阶段的安全风险防控

2)虚假新闻防范

大模型直接识别

微调的 AIGC 文本检测模型识别

依据困惑度与可信度

基于事实核查的虚假新闻检测关键技术:

声明检测

证据检索

声明核查

3)版权侵犯风险防范

面向 AI 训练数据安全的水印技术:后门攻击。

面向 AI 生成内容溯源的水印技术:

✔数字水印技术

✔快速微调技术

✔有效水印提取技术

4)电信诈骗风险防范

深度伪造检测技术:

✔基于空间域信号

✔基于频域

✔基于生物信号

深度伪造主动防御技术:

✔基于主动干扰

✔基于主动取证

落地的 可靠性

(1)大模型的对抗鲁棒性

数据增强:针对不同内容模态设计策略以提升训练样本多样性。

训练优化:跨模态数据构建针对性对齐 loss 训练;采用预设攻击函数对样本变换进行对抗训练。

增强用户指令精细理解力,检测攻击诱导意图并前置干预。

(2)大模型的真实性

幻觉主要缓解方案:

训练阶段改进:涉及预训练、微调等所有模型参数更新。

推理阶段干预:根据用户输入生成回复时进行干预。

提示语优化:通过优化提示语提升生成效果。

输出后处理:对初步生成文本进一步编辑、修改。

结合外部知识检索:结合外部知识源的信息检索单元加强生成质量。

多智能体交互:引入多个大语言模型参与生成过程。

(3)大模型的价值对齐

1)基础优化手段:

清洗训练样本中的 “毒性” 数据

引入基于强化学习的对齐技术

2)基于人类偏好的强化学习技术(RLHF):

包含三个子阶段:

指令微调

奖励模型训练

生成策略优化

3)基于 AI 反馈的强化学习技术(RLAIF):

特点:用 LLM 代替人类标记偏好,对齐效果有限。

优化方向:结合人工反馈,兼顾成本与模型效果。

落地的 可控性

(1)大模型的可解释性

基于过程信息的解释性

基于 CoT(思维链)提示的解释性

基于模型内生的机制可解释性

(2)大模型的可标识和可追溯

数字水印追溯

AIGC 检测技术

(3)大模型的指令遵循

监督微调

强化学习

指令优化

落地 安全测评

(1)试题的全面性:

要求:安全评估需覆盖多模态和各种应用场景,且评测试题需全面覆盖可能的安全问题类型。

(2)对抗样本的多样性:

方法:在已有试题基础上通过生成算法构建多样化测试样本。

(3)评估研判的自动化:

新方向:

基于商业化大模型服务构建研判策略,但存在成本高、数据隐私、可控性差等问题。

构建专用研判大模型

私域安全部署 全流程示例

以下内容仅供参考

具体需根据实际情况进行调整和优化

获取完整版

请文未评价留言

大模型 安全评估

以下内容仅供参考

具体需根据实际情况进行调整和优化

获取完整版

请文未评价留言

网络安全运营 大模型

参考架构与赋能

以下内容仅供参考

具体需根据实际情况进行调整和优化

获取完整版

请文未评价留言

其它场景及应用 案例

以下内容仅供参考

具体需根据实际情况进行调整和优化

获取完整版

请文未评价留言

参考资料:《大模型落地路线图研究报告》《大模型安全实践白皮书》《私有化部署必看!大模型设施的安全风险框架和防护方案》《专题·人工智能安全|大模型安全风险分析与防护架构》《超云2025私域大模型部署白皮书》《生成式大模型安全评估白皮书》《工业大模型白皮书》《金融行业大模型应用探索与实践》《网络安全运营大模型参考架构》《大模型安全研究报告》

来源:重庆信通设计院天空实验室